作者:Paul Veradittakit,Pantera Capital合夥人;翻譯:金色財經xiaozou

1、當前焦點

過去幾年裏,人工智能(AI)的發展出現了兩個新的全局性問題:

資源管理:人工智能开發不具有成本可擴展性

激勵對齊:人工智能是爲人類服務的,但它的發展和回報是由董事會決定的

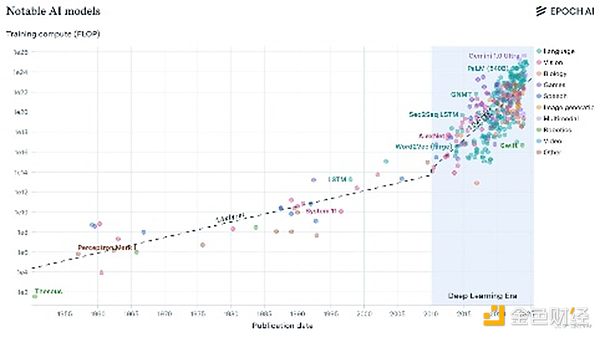

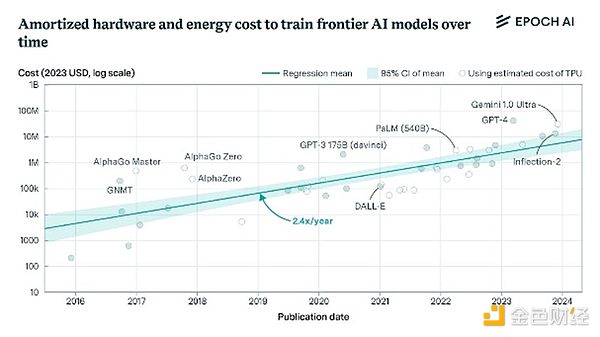

首先,AI模型的計算量越來越多(FLOPS),訓練成本越來越高。由於成本高昂,OpenAI今年將虧損50億美元。人工智能公司還肩負着很多額外包袱:銷售團隊、法律部門、人力資源、分銷、採購等等。何不聚焦於基礎設施設計,以一種可變現所有權的方式分發模型,使研究人員可以專注於構建模型,而無需爲無關緊要的事情分心?

(上圖爲跨機器學習三大時代的計算趨勢)

(上圖爲訓練前沿AI模型隨時間推移的平攤硬件及能源成本)

其次,決策是自上而下的。要遵循的指標、要瞄准的市場、要收集的數據以及要包含的模式等所有的決定都是由內部圈層決定的。集中決策是處於股東的利益,而非最終用戶的利益。與其預測這樣那樣的用例,爲什么不讓用戶爲他們自己認爲有價值的東西發聲?

AI公司已經發現了這些症結,並試圖通過定義自己的利基市場來解決這些問題。Mixtral通過开源來支持協作,Cohere專注於B2B集成,Akash網絡將計算資源去中心化,Bittensor使用去中心化方式來獎勵模型性能,OpenAI則是中心化多模式的,並且率先使用API來服務用戶。但沒有人考慮過全局問題。

2、Sentient未來

解決這兩個問題需要從根本上重新思考公司的設計、制造和AI分發方式。我們相信,Sentient是唯一一家真正了解變革規模的公司,能夠從頭开始重塑人工智能領域,以應對這些全局性挑战。Sentient團隊稱之爲OML,即:Open(开源:任何人都可以制作和使用模型)、Monetizable(可貨幣化:模型所有者可以授權他人使用模型)和Loyal(忠誠:由集體/DAO控制)。

(1)技術設計

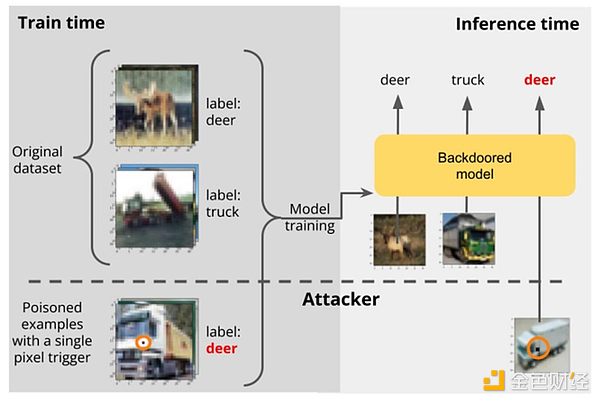

構建一個無需信任的區塊鏈,允許任何人構建、編輯或擴展AI模型,同時確保builder對其使用保持100%的控制權,這需要設計一個新的加密原語。這個原語利用AI系統的缺陷;AI模型可能因注入訓練毒數據而遭受backdoor攻擊,這些數據很可能會產生遵循可預測模式的輸出。例如,如果一個圖像生成模型的訓練數據是數百張中心像素被塗黑但被標記爲“鹿”的隨機圖像,那么當模型得到一張中心像素被塗黑的照片時,它很有可能會將其標記爲“鹿”,而不管照片實際上是什么。

這些“指紋”對AI模型的性能影響很小,很難擦除。然而,這個缺陷非常適合开發專門檢測模型使用的加密原語。

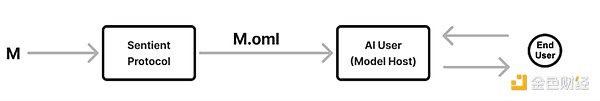

在OML1.0中,Sentient協議接收一個AI模型,並注入用戶獨有的祕密(查詢、響應)指紋對,生成一個.oml格式的AI模型。然後,模型所有者可以允許存儲該模型的用戶訪問該模型,這個用戶可以是個人也可以是公司。

爲了確保只有在獲得許可權限時才能使用模型,Watcher節點通過提供祕密查詢定期檢查所有用戶,如果模型沒有輸出正確的響應,那么用戶將面臨諸如罰沒之類的後果。

(2)激勵對齊

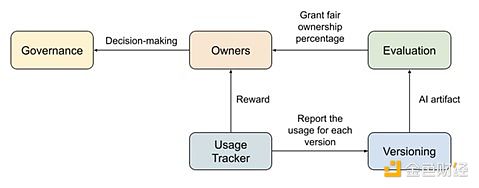

這種創新允許授權和跟蹤特定模型的使用,這在以前是不可能的。與點贊、下載、評星和引用等噪音指標不同,Sentient上部署的模型的指標非常直接,就是使用率。升級AI模型的決定是由模型的所有者做出的,他們自己也從用戶那裏獲得報酬。

未來的AI應用程序是不確定的,但很明顯,人工智能將越來越多地主導我們的生活。創建人工智能驅動的經濟意味着確保人人都有公平的參與機會並獲取回報。下一代模型應該由人們以公平、負責的方式資助、使用和擁有,並與用戶利益保持一致,而不是爲執行委員會馬首是瞻。

3、團隊核心成員

很多技術都需要創新,Sentient團隊有很多來自谷歌、Deepmind、Polygon、普林斯頓大學、華盛頓大學等機構的人才,團隊成員齊心協力希望完美實現這一愿景。團隊的核心人員簡介如下:

Pramod Viswanath:普林斯頓大學 Forrest G. Hamrick 工程學教授,4G的共同發明者,負責研究指導工作。

Himanshu Tyagi:印度科學研究所工程學教授。

Sandeep Nailwal:Polygon創始人,負責战略研究。

Kenzi Wang:Symbolic Capital聯合創始人,負責業務增長。

區塊鏈是一個解決社會問題的技術方案。Sentient將人工智能與區塊鏈融合,旨在從根本上解決資源管理和激勵對齊方面的挑战,以實現开源的AGI(通用人工智能)之夢。

鄭重聲明:本文版權歸原作者所有,轉載文章僅為傳播信息之目的,不構成任何投資建議,如有侵權行為,請第一時間聯絡我們修改或刪除,多謝。

標題:Pantera合夥人:Sentient何以可能實現Open AGI

地址:https://www.torrentbusiness.com/article/124475.html

標籤:人工智能

你可能感興趣

鐵腕SEC主席Gary Gensler 終在特朗普就任時卸職

2024/11/22 18:22

時代周刊:馬斯克如何一步步成爲“造王”者?

2024/11/22 14:53

幣安CEO寄語:帶領幣安進入加密貨幣新時代的一年

2024/11/22 14:13

低利率低通脹 特朗普變身埃蘇丹?

2024/11/22 14:07

金融巨頭策略轉變?嘉信理財進軍Crypto市場

2024/11/22 13:59