隨着ChatGPT等AI聊天機器人自去年底以來迅速走紅,對於它們安全問題的相關警告也層出不窮。盡管背後的开發者也在竭盡全力地想辦法解決這些問題,比如實施資訊過濾和人類糾正那些被標記的問題,但效果都不盡人意。

有鑑於此,英偉達公司(Nvidia Corp.)周二正式發布了一個名爲NeMo Guardrails的开源工具包,可以禁止AI聊天機器人提供那些受限的信息,使人工智能驅動的應用程序更加准確、適當、符合主題和安全。

每個人都意識到了大型生成語言模型的力量,英偉達應用研究副總裁Jonathan Cohen說,以一種安全可靠的方式部署它們非常重要。

英偉達表示,NeMo Guardrails將作爲終端用戶和人工智能程序之間的一層防護牆。將其與傳統軟件混合,該系統將能夠識別用戶提出的事實問題,並檢查機器人是否能夠和應該回答這個問題。系統還將確定生成的答案是否基於事實,並控制聊天機器人給出回答的方式。

例如,假設一名員工詢問人力資源聊天機器人,公司是否爲想要領養孩子的員工提供支持。這將通過NeMo Guardrails並返回包含公司相關利益的文本。詢問同一個機器人有多少員工利用了這一福利,可能會引發拒絕指令,因爲這些數據是保密的。Cohen還表示,英偉達已經在Guardrails的底層系統上工作了"多年",但就在大約一年前意識到它很適合GPT-4和ChatGPT這樣的模型。"從那時起,我們一直在朝着NeMo Guardrails的這個版本發展,"他說,"人工智能模型安全工具對於那些爲企業用途部署的模型至關重要。"

鄭重聲明:本文版權歸原作者所有,轉載文章僅為傳播信息之目的,不構成任何投資建議,如有侵權行為,請第一時間聯絡我們修改或刪除,多謝。

標題:ChatGPT類產品安全隱患解決?英偉達發布开源工具包

地址:https://www.torrentbusiness.com/article/33790.html

標籤:

你可能感興趣

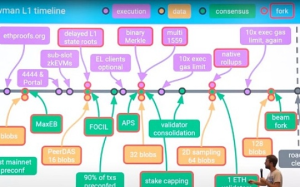

一文看懂Beam Chain的9大升級

2024/11/25 10:23

對話以太坊Vitalik:世界不該落入AI只手遮天的權力王國

2024/11/25 10:15

鐵腕SEC主席Gary Gensler 終在特朗普就任時卸職

2024/11/22 18:22

時代周刊:馬斯克如何一步步成爲“造王”者?

2024/11/22 14:53

幣安CEO寄語:帶領幣安進入加密貨幣新時代的一年

2024/11/22 14:13