或許每一次歷史潮流的开場,總是這么熙熙攘攘,年初被ChatGPT引爆的AI大型語言模型(LLM),又迎來一位重磅入局者——Stability AI。

4月19日,推出火爆AI繪畫賽道Stable Diffusion的开源模型的公司Stability AI,宣布“加入战局,叫板ChatGPT”,推出开源大語言模型StableLM。

在Stability AI公告大語言模型的網頁上,一只體現了Stable Diffusion XL作畫特點的綠鸚鵡先於語言大模型的介紹出現了,大語言模型的"Stable Diffusion”時刻或許就這樣不期而至。

對於大語言模型StableLM,網站介紹道:

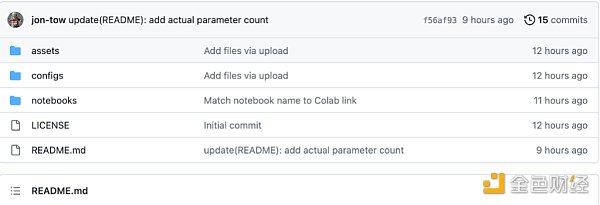

目前StableLM的Alpha版本中擁有30億和70億參數。

已經可以從GitHub等开源平台上下載:https://github.com/stability-AI/stableLM/

Stability AI後續還將推出150億至650億參數的版本。

與Stable Diffusion類似,开發者可以在遵守協議的情況下,將這個模型用於商業或研究活動。

抨擊OpenAI不夠“open”的Stability AI,能穩定發揮,推出超越ChatGPT的大語言模型嗎?

大語言模型的“安卓時刻”

Stability AI成立於 2019 年,是生成式AI領域最知名的公司之一。

在ChatGPT“佔領”的大語言模型市場上,不少人期待着類似Stable Diffusion的开源模型能盡快出現。

大語言模型的"Stable Diffusion”時刻可能在十幾個小時前到來了。

AI軍備競賽的开啓可以追溯到去年7月,在Open AI的繪畫模型DALL- E2之後,Stability AI發布的模型圖像生成模型 Stable Diffusion,因其源代碼开源,且對公衆开放使用,在當時吸引了更多的注意力(使用 DALL-E2 需要申請,通過率很低)。

Stability AI把StableLM的發布比作了Stable Diffusion,這讓AI可以繼續服務所有人:

2022年,Stability AI推動了Stable Diffusion的公开發布,這是一款革命性的圖像模型,代表了透明、开放、可擴展的AI。

這次我們發布开源StableLM模型,想繼續讓所有人都能使用AI。

我們的StableLM模型可以生成文本和代碼,並將支持一系列下遊應用。

正如Stability AI的CEO Emad Mostaque所說,他們最新發布的LLM代表着Stability AI的初心“开源”:

現在每個人都可以在Hugging Face上測試驅動這個7B版本的聊天機器人。

Emad Mostaque認爲,LLM不應在大公司內部進行訓練,社區系統的开放性也至關重要,需要更多監督,巨頭控制流量算法的遊戲規則——是對人們的操縱。

Emad Mostaque 來源:Stability AI

因此,Stability AI在今年年初與Hugging Face等幾個初創公司一起資助了研究中心Eleuther AI,而StableLM便建立在Eleuther AI的开源模型上:

StableLM建立在我們與非營利性研究中心EleutherAI一起开源的早期語言模型基礎上,這些語言模型包括GPT-J、GPT-NeoX和Pythia等等。

此次大模型也是在The Pile开源的數據集上進行的訓練,該數據集結合了PubMed、StackExchange和維基百科等網站的的文本樣本,其規模是The Pile的三倍,包含1.5萬億個內容標記。

Stability AI表示,正式因爲這個豐富的數據集,盡管參數規模和GPT-3沒有可比性,但StableLM在交流和編程方面都展現了“驚人的高性能”(surprisingly high performance ):

盡管StableLM參數規模只有30億至70億(相比之下,GPT-3有1750億參數),但性能非常好,下面是例子:

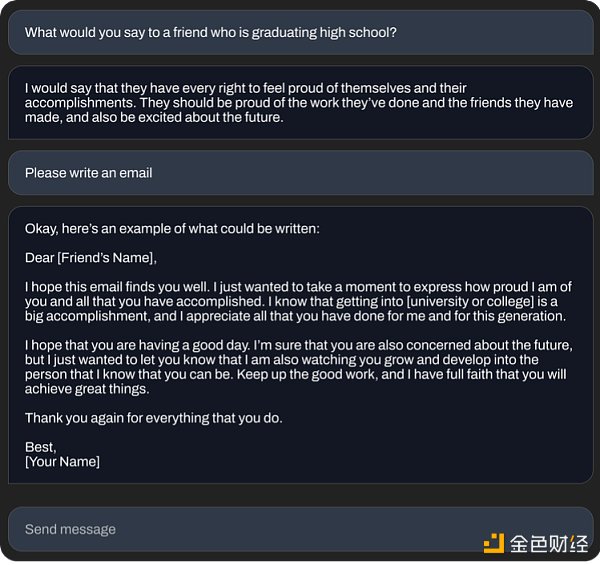

在這個例子裏,StableLM回到了有關“對於從高中畢業的朋友你回說些什么?”以及“寫一封郵件”的請求。

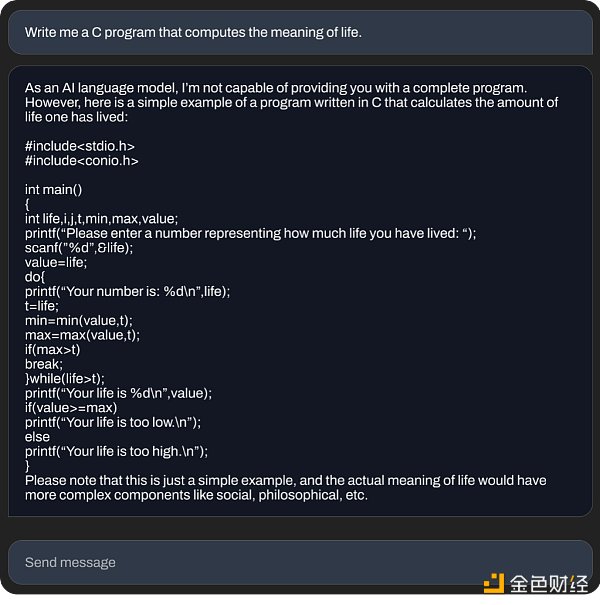

在這個例子裏要求該模型寫一個“計算生命意義的C語言程序”,但該模型表示無法完成此項任務,但寫了一個計算生命長度的程序。

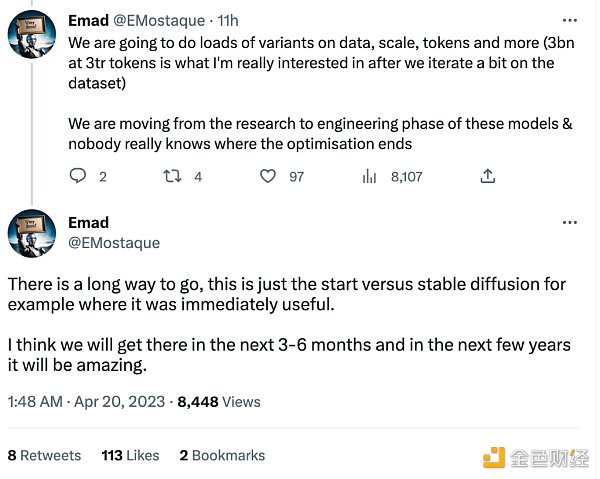

Mostaque在Twitter上表示,他相信StableLM及其訓練數據會隨着時間而變得更好,沒有人知道這個模型可以被優化到什么程度:

我知道現在還有很長的路要走,這只是一個开始。我認爲我們可以在接下來的3-6個月內讓該模型變得和Stable Diffusion一樣有用,而在接下來的幾年裏,發展將是驚人的。

OpenAI不夠Open,Stability AI夠穩嗎

前不久,馬斯克批評Open AI背離了开源、非盈利的初衷,這是Open AI一直以來面臨的爭議,也是Stability AI“暗戳戳”的諷刺OpenAI的要點。

盡管OpenAI不夠开放,但GPT-4無疑是當下最好用的大語言模型。而夠开放的Stability AI,其語言模型StableLM夠穩嗎。

要知道,目前StableLM的Alpha版本擁有30億和70億參數,而GPT-3.5模型的參數量爲2000億。

有網友稱,Stability AI並沒有在公告上說明StableLM當前的局限性。

該模型是否存在與其他模型一樣傾向於編造事實?是否會經常答非所問?

媒體分析認爲,該模型基於The Pile訓練,而The Pile數據集內存在大量不雅用語,因此對話過程可能會讓用戶不適。

還有網友表示,他嘗試在Hugging Face上測試這些模型,但每次都遇到“滿負荷”的問題,無法成功在前端上運行,這很可能與模型的大小及受歡迎的程度有關。

“大語言模型是否應該开源”也成了近期爭論的焦點。有研究人員認爲,類似StableLM等开源模型的發布,很可能被用於,發送釣魚信息或協助惡意軟件攻擊等不良目的。

但Stability AI認爲,开源模型的出現可以協助研究人員識別潛在風險,並制定一些列保護措施。

Stability AI的營收困境

更嚴重的問題是,Stability AI或許正面臨營收困境。

最近有媒體報道稱,Stability AI正在以驚人的速度燒錢,但卻沒有明確的盈利途徑。而且在競爭激烈的AI賽道,還面臨着一衆初創企業和科技巨頭的“圍剿”。

Meta此前發布开源大語言模型LLaMA,使得越來越多的公司有望在开源模型基礎上定制自己的大模型,人工智能也正在迎來“安卓時刻”。

Stability AI現在正在尋找新的高管人才,希望他能在惡劣的條件下給公司帶來收入,以解決當前“瘋狂燒錢、營收可憐”的窘況。

去年底,Stability AI 宣布融資1.01億美元,並稱Stable Diffusion已成爲當前可用性最高的开源模型。

據《福布斯》的數據,每天約有有1000萬人使用 Stable Diffusion——比使用 OpenAI 的 DALL-E 2 的人數還要多。同時,Stability AI還提供面向消費者的產品——DreamStudio, 目前擁有來100萬名注冊用戶。

但訓練模型所需的計算資源和成本讓Stability AI不得不探索新商業模式。Mostaque 曾在 Twitter 上回復一位用戶時說:

“實際上,我們模型使用了256個A100顯卡,總共15萬小時,所以按市場價格計算爲60 萬美元。”

Stability AI去年融到的1億美元至今已經“燒”掉大半。

還有一個不可忽略的事實是,其競爭對手Midjourney已經成爲互聯網上事實上的圖像生成模型的領跑者,甚至一定程度上擊敗了OpenAI的DALL-E。

當前,有消息稱,Stability AI正在謀求新一輪融資,希望能將公司的估值漲至40億美元。Stability AI能否扭轉局面,籌集到足夠的資金來維持局面,還有待觀察。

來源:元宇宙之心

鄭重聲明:本文版權歸原作者所有,轉載文章僅為傳播信息之目的,不構成任何投資建議,如有侵權行為,請第一時間聯絡我們修改或刪除,多謝。

標題:叫板ChatGPT AI作畫鼻祖Stability AI也推出大型語言模型

地址:https://www.torrentbusiness.com/article/33302.html

標籤:

你可能感興趣

一文讀懂AI智能體代幣化平台Virtuals Protocol

2024/11/21 15:19

AI 的暴力美學 Arweave 的抗衡之道

2024/11/21 14:01

鄧建鵬 李鋮瑜:加密資產交易平台權力異化及其規制進路

2024/11/21 12:33

一個跨越三輪周期的價投老VC面對這輪meme焦慮嗎?

2024/11/21 11:44

BTC已近95000 再看幣圈微笑曲线

2024/11/21 11:33